この記事では次のことを学びます:

- Azure Logic Appsとは何か、その提供内容。

- Azure Logic AppsでBright DataのSERP APIを統合する戦略的優位性

- Bright DataのSERP APIに接続するAzure Logic Appワークフローの構築方法。

さっそく始めましょう!

Azure Logic Appsとは?

Azure Logic Appsは、コードをほとんど、あるいは全く書かずに自動化されたワークフローを作成・実行できるクラウドベースの統合プラットフォームです。ビジュアルデザイナーと1,400以上の事前構築済みコネクタを提供し、クラウドとオンプレミス環境を跨いだサービス、システム、アプリ、データソースの接続を可能にします。

その主な目的は、ビジネスプロセスの自動化と異種システムの統合を支援することです。これは、ローコード/ノーコードのドラッグアンドドロップ式ワークフロービルダー、イベントベースのトリガー、Gmail、Office 365、Salesforce、SAP、SQL、Azureなどのサービスに対応する大規模なコネクタエコシステムによって実現されます。

Azure Logic Apps と Azure AI Foundry の違いは?

SERP APIとAzure AI Foundryの統合ガイドを既にお読みの方は、Logic Appsとの違いについて疑問に思われるかもしれません。両者は根本的に異なる目的を果たします:

- Azure AI Foundryは、AIアプリケーション、エージェント、プロンプトフローの構築・デプロイ・管理に特化した統合AI開発プラットフォームです。Azure OpenAI、Meta、MistralなどのLLMカタログへのアクセスを提供し、プロンプトエンジニアリング、モデルの微調整、RAGワークフローを含むAIファースト開発向けに設計されています。

- Azure Logic Appsは、システム間の接続、ビジネスプロセスの自動化、数百のサービスにまたがるタスクのオーケストレーションに焦点を当てたワークフロー自動化および統合プラットフォームです。イベント駆動型自動化、データ転送、ノーコードでのAPI統合に優れています。

要するに、Azure AI FoundryはAI駆動アプリケーションとプロンプトフローを構築する場所であり、Azure Logic Appsはシステムを接続する自動化されたイベント駆動型ビジネスワークフローを構築する場所です。

両者は実に完璧に補完し合います。Azure Logic AppsはAzure AI Foundryのエージェント向けアクションとして機能し、AIエージェントからLogic Appsワークフローをトリガーできます。本チュートリアルでは、Pythonを1行も記述せず、LLMをデプロイすることなく、Logic Apps単体でBright DataのSERP APIと統合し、強力な自動化されたWeb検索ワークフローを構築する方法を紹介します。

Bright DataのSERP APIをAzure Logic Appsに統合する理由

Azure Logic Appsは強力なHTTPコネクタを提供し、あらゆるREST APIを呼び出せます。これによりワークフローと外部データソースの連携が可能になります。しかし自動化ワークフローにリアルタイムのウェブ検索データを注入するには、信頼性が高くスケーラブルな構造化データソースが必要です。

そこでBright Dataのマルチエンジン検索結果APIが活躍します。SERP APIはGoogle、Bing、DuckDuckGo、Yandexなどの検索エンジンでクエリをプログラム的に検索し、完全なSERPコンテンツを取得できます。パース済みJSON、生のHTML、AI対応Markdownなど複数の形式でデータを返すため、信頼性の高い最新かつ検証可能なデータソースを提供します。

このアプローチは特に以下に有用です:

- ブランド・競合・業界トピックに関するニュースを追跡しメール通知を受信する自動モニタリングワークフロー

- リードジェネレーションパイプライン:特定のビジネスリスティングを検索し、結果をCRMに連携。

- トピックのトレンド記事を収集し、SharePointやデータベースに保存するコンテンツキュレーションシステム。

- 価格監視・製品モニタリング:検索結果から価格データを定期的にチェックし、変更時にアラートを発動。

Azure Logic Appsのノーコード自動化機能と、Bright DataのAIエージェント向けWebアクセスインフラを組み合わせることで、スクレイピングインフラを維持することなく、リアルタイムのWebデータに反応するワークフローを作成できます。

SERP APIを使用したAzure Logic Appでのウェブ検索コンテキストの取得方法

このガイドセクションでは、ニュース監視およびアラートシステムの一環として、Bright DataのSERP APIをAzure Logic Appワークフローに統合する方法を説明します。このワークフローは主に4つのステップで構成されます:

- スケジュールトリガー:ワークフローは定期的なスケジュール(例:毎日)で実行されます。

- ニュース取得:HTTPアクションがBright DataのSERP APIを呼び出し、事前定義されたトピックに関するGoogleのニュース記事を取得します。

- レスポンスパース: Parse JSONアクションがSERP結果を構造化し、後続処理に備えます。

- アラート配信:「For each」ループが結果を反復処理し、Gmailコネクタ経由で上位ニュース記事ごとにメールを送信します。

注:これは一例に過ぎず、SERP APIは他の多くのシナリオやユースケースでも活用できます。例えば、SERPデータを活用したRAGチャットボットやブランド評判監視ワークフローの 構築も可能です。

以下の手順に従い、Azure Logic Apps内でBright DataのSERP APIを活用した自動ウェブ検索ワークフローを構築しましょう!

前提条件

このチュートリアルセクションを実践するには、以下の準備が必要です:

- Microsoftアカウント

- Azure サブスクリプション(無料トライアルでも可)。

- 有効なSERP APIゾーンとAPIキー(管理者権限付き)を持つBright Dataアカウント。

公式のBright Dataドキュメントに従って、SERP APIゾーンを設定し、APIキーを取得してください。APIキーとゾーン名はすぐに必要になりますので、安全な場所に保管してください。

ステップ1: 新しいロジックアプリを作成する

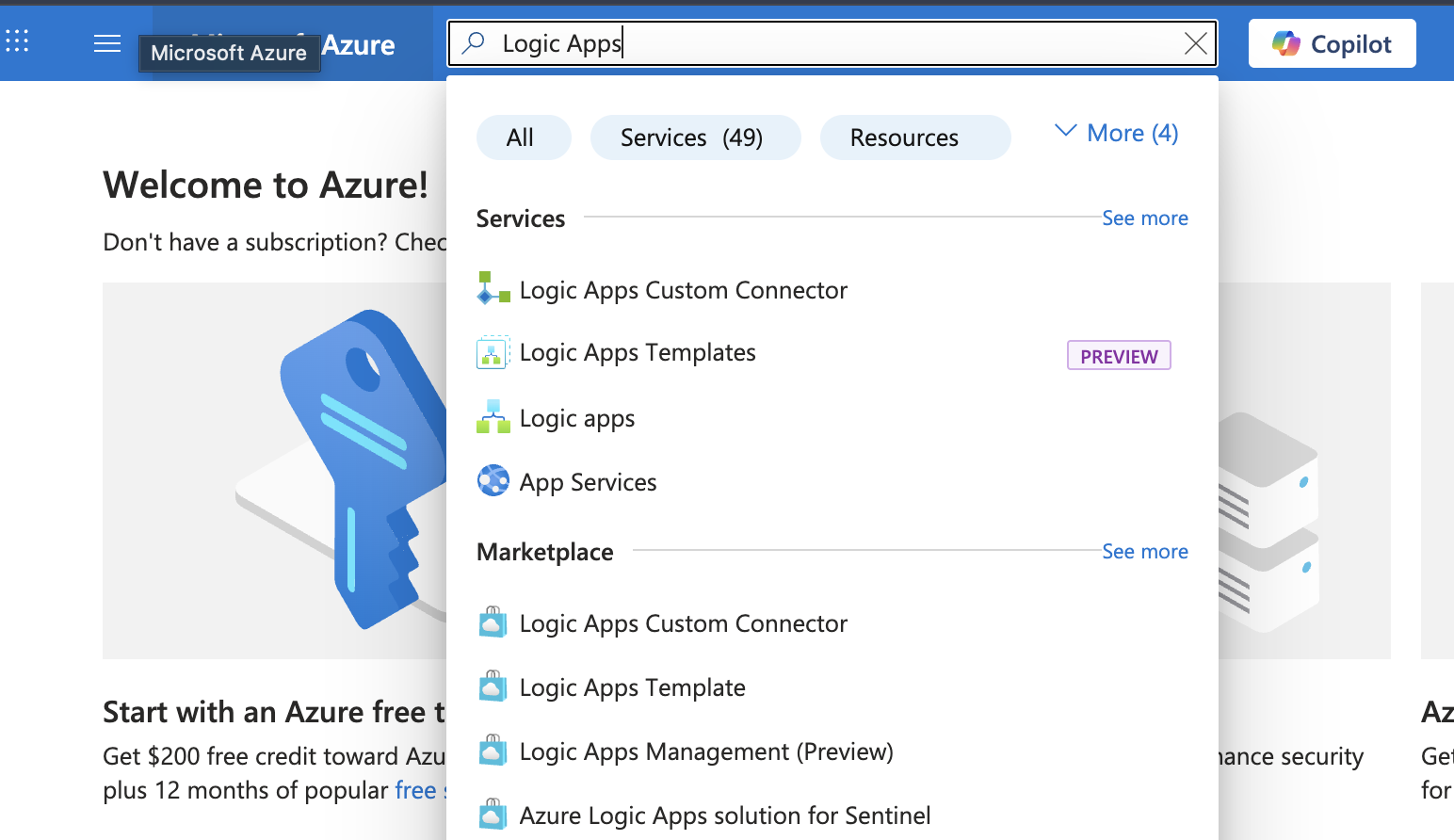

Azureアカウントにログインし、Azureポータル上部の検索バーで「Logic Apps」を検索します:

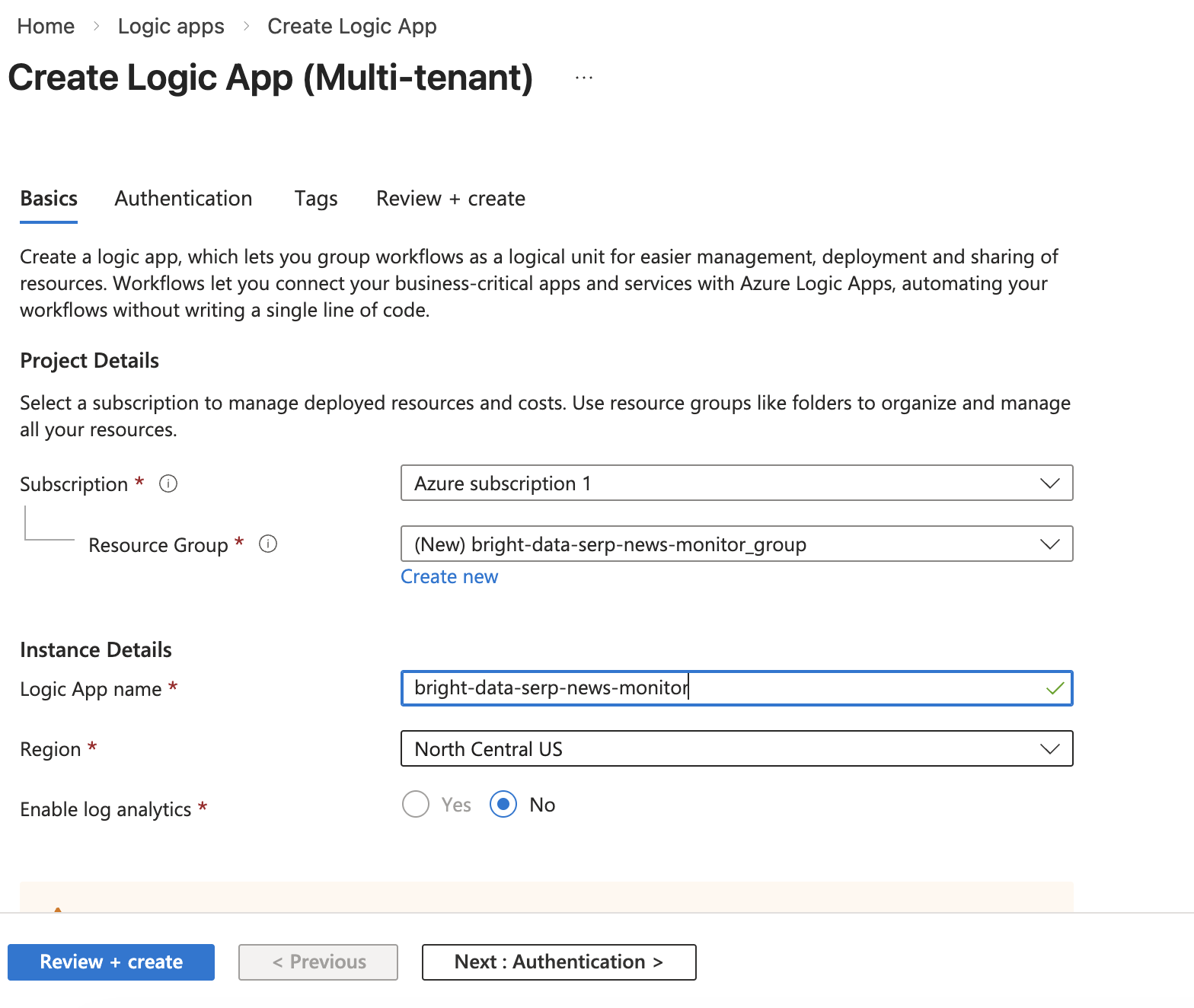

Logic Apps管理ページで「作成」ボタンをクリックします。作成フォームに入力します:

- プランの種類で「使用量課金」を選択:(実行ごとの課金、このチュートリアルに最適)。

- Azure サブスクリプションを選択します。

- 既存のリソースグループを選択するか、新規作成します。

- わかりやすい名前を付けます(例:

bright-data-serp-news-monitor)。 - お近くのリージョンを選択します。

[レビュー + 作成]、[作成] の順にクリックして Logic App をデプロイします。

デプロイが完了するまでお待ちください。準備が整ったら、[リソースに移動]をクリックして新しい Logic App を開きます。

ステップ 2: 繰り返しトリガーでワークフローを初期化する

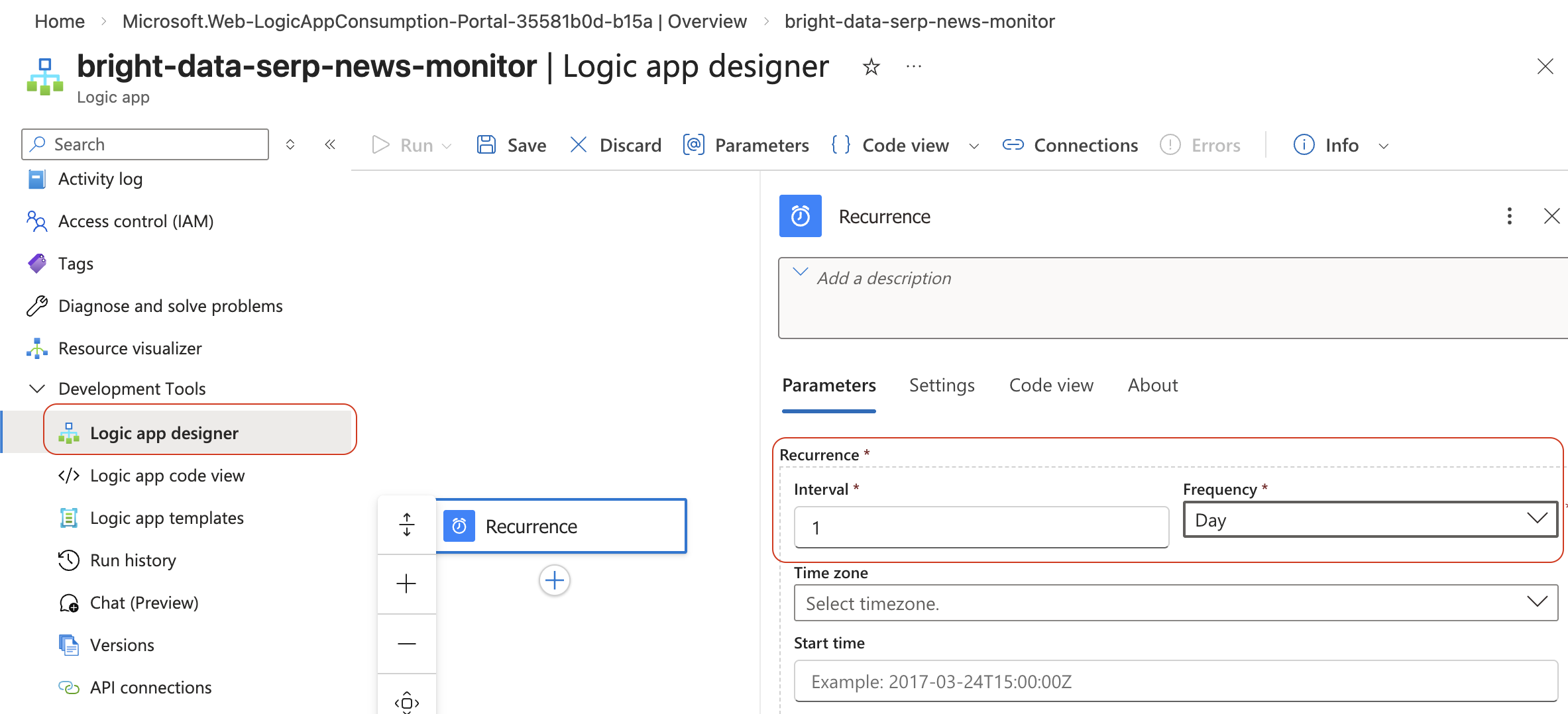

デプロイが完了したら:

- 開発ツールの「デザイン」を開き、「Logic App Designer」を選択します。

- トリガーの選択すべての Logic App はトリガーから開始する必要があります。

- スケジュールに基づいてワークフローを開始するには「繰り返しトリガー」を選択します。以下のように設定します:

- 間隔:

1 - 頻度:

毎日

これによりワークフローは1日1回自動的に実行されます。必要に応じて頻度を調整可能(例:即時監視のため毎時実行設定)。

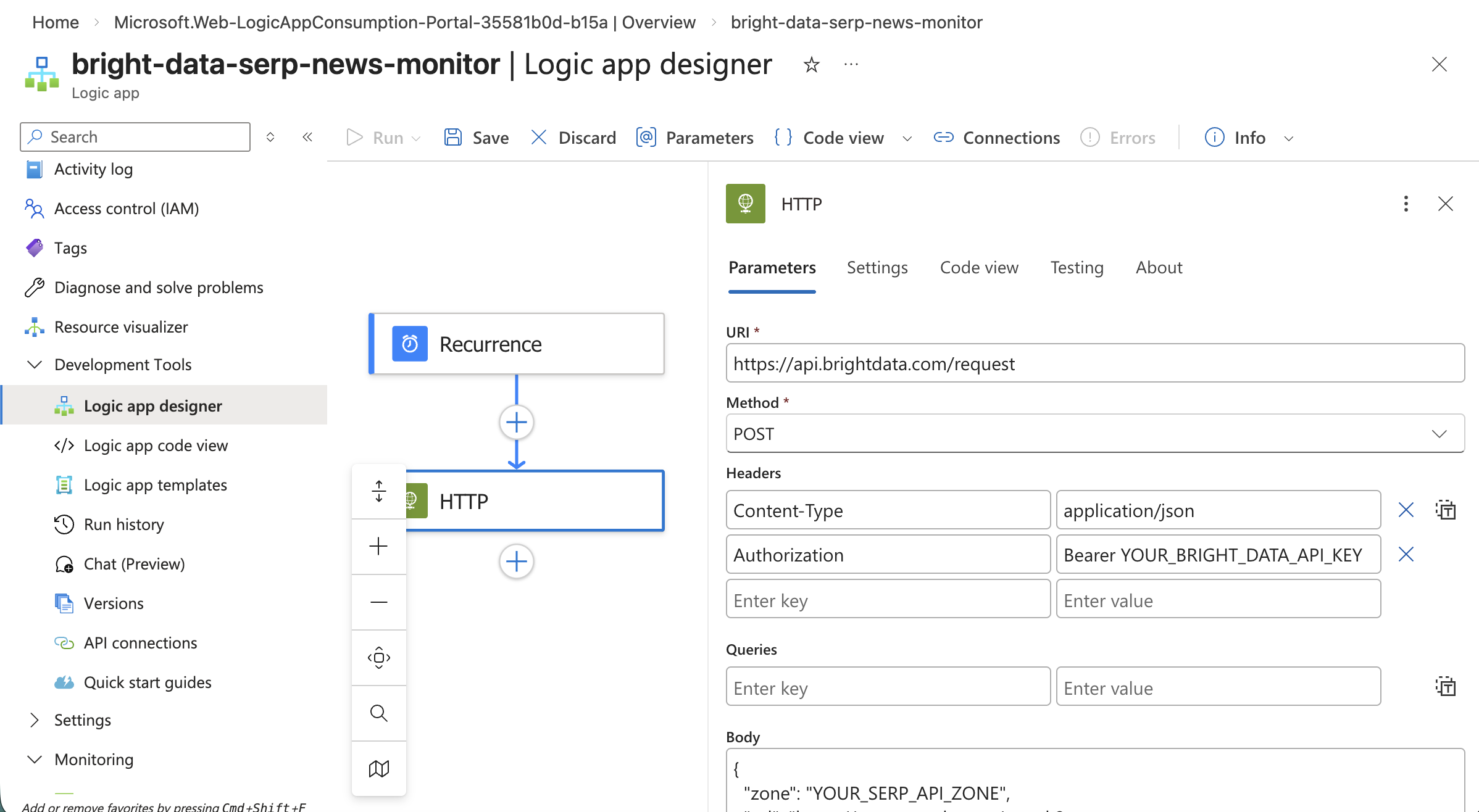

ステップ3: SERP APIを呼び出すHTTPアクションを追加

次に、Bright DataのSERP APIを呼び出すアクションを追加します。+をクリックし、「アクションを追加」を選択、アクションリストで「HTTP」を検索します。HTTPアクション(コネクタではなく組み込みのアクション)を選択してください。

HTTPアクションを以下の設定で構成します:

- メソッド:

POST - URI:

https://api.brightdata.com/request - ヘッダー:

Content-Type:application/json.Authorization:Bearer YOUR_BRIGHT_DATA_API_KEY- Body:

{

"ゾーン": "YOUR_SERP_API_ゾーン",

"url": "https://www.google.com/search?q=stock+market+news&tbm=nws&hl=en&gl=us",

"format": "raw",

"data_format": "markdown"

}

このリクエストの動作を分解してみましょう:

zone: Bright Dataダッシュボードで設定したSERP APIゾーン名。url: ニュース検索結果用のGoogle検索URL(tbm=nwsでGoogleニュースを指定)。qクエリパラメータをカスタマイズして任意のトピックを監視可能。format:"raw"に設定すると生のレスポンスを取得します。data_format:parsed_lightに設定すると、タイトル、URL、説明を含むオーガニック検索結果の JSON 配列が返されます。

ヒント: SERPコンテンツをクリーンな形式で受け取るには、

「data_format」を「markdown」に設定してください。これにより構造化されたMarkdown形式が返され、人間の可読性とLLM処理の両方に最適です。利用可能な全オプションについてはSERP APIドキュメントを参照してください。セキュリティのヒント: 本番環境のワークフローでは、APIキーをHTTPアクションに直接ハードコーディングしないでください。代わりに、Azure Key Vaultに保存し、ロジックアプリ内のKey Vaultコネクタを使用して参照します。これにより、認証情報が暗号化され、安全に管理されます。

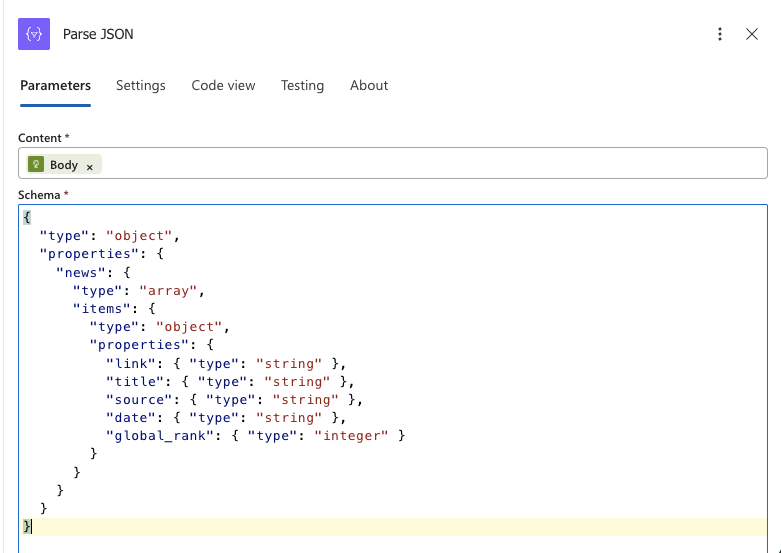

ステップ4: SERP APIレスポンスのパース

HTTPアクションがSERPデータを取得したら、後続のステップで使用するためにレスポンスをパースする必要があります。

data_format: "markdown" を使用した場合、レスポンス本体は Markdown 文字列になります。これをメール本文に直接使用したり、ファイルに保存したりできます。

構造化データを希望する場合は、SERPAPIリクエストでdata_format: "parsed_light"を使用するように変更します。その場合、HTTPステップの後に「JSONのパース」アクションを追加します:

- 「+」をクリックし、「アクションを追加」を選択して「Parse JSON」を検索します。

- [コンテンツ]フィールドで、HTTPアクションからの[本文出力]を選択します。

- スキーマフィールドには、SERP APIのレスポンス構造に対応するJSONスキーマを貼り付けます。これはSERP APIに対してテストリクエストを実行し、「サンプルペイロードを使用してスキーマを生成」オプションを使用することで生成できます。

以下はparsed_lightフォーマットの例です:

{

"type": "object",

"properties": {

"news": {

"type": "array",

"items": {

"type": "object",

"properties": {

"link": { "type": "string" },

"title": { "type": "string" },

"source": { "type": "string" },

"date": { "type": "string" },

"global_rank": { "type": "integer" }

}

}

}

}

}

これにより、タイトル、リンク、説明などの個々の検索結果フィールドが、後続のアクションで動的コンテンツとして利用可能になります。

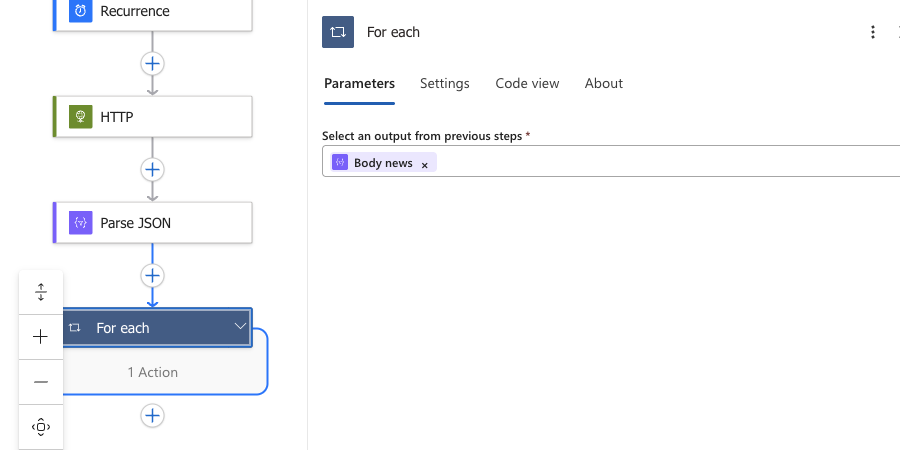

ステップ5: 結果を反復処理しメールアラートを送信

SERP結果をパースしたので、各ニュース記事をループ処理しメールアラートを送信できます。

- 「+」をクリックし、「アクションを追加」を選択して「For each」制御アクションを追加します。

- 「前のステップからの出力を選択」フィールドで、Parse JSON出力から

news配列を選択します。

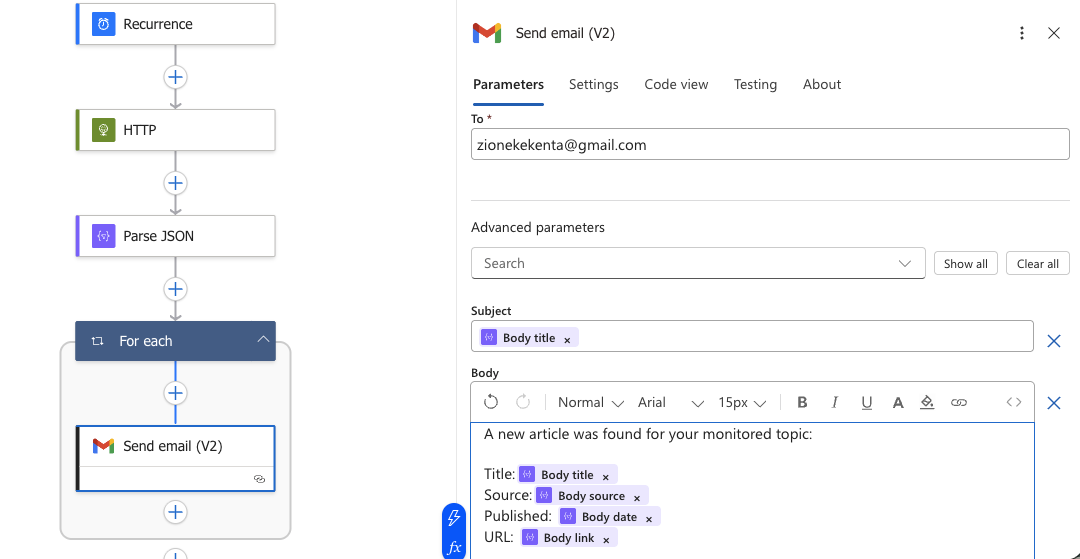

- For each ループ内で、アクションを追加をクリックし、Gmailを検索して接続します。

- メールアクションを設定します:

- 宛先: 自身のメールアドレス(または配布リスト)。

- 件名: 件名フィールドをクリックし、「動的コンテンツを追加」(稲妻アイコン)をクリック。動的コンテンツパネルから「

タイトル」を選択。 - 本文:静的テキストと動的コンテンツトークンを組み合わせて本文を作成します。本文フィールドをクリックし、静的なラベルテキストを入力します。次に「動的コンテンツを追加」パネルを使用して、パースされたJSONの各フィールドを挿入します。

ステップ 6: ワークフローの保存とテスト

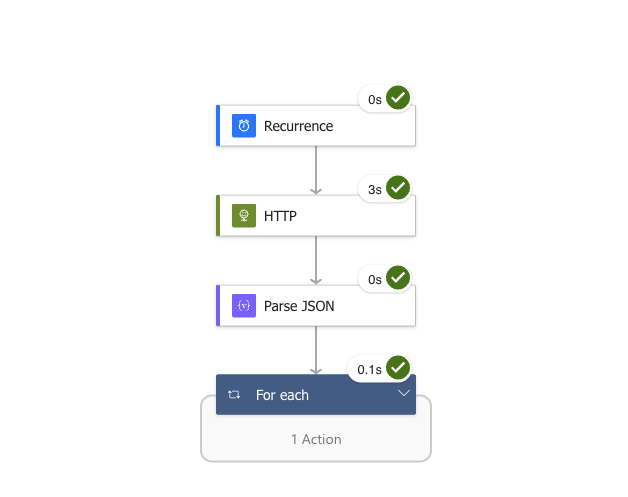

すべてのステップを設定すると、ロジックアプリのワークフローはデザイナー上で以下のように表示されます(上から順に):

- 繰り返し→ 毎日トリガー

- HTTP→ Bright Data SERP APIを呼び出し

- JSONパース→ レスポンスを構造化

- 各項目ごとに→ 各ニュース結果をループ処理

- メール送信→ 各記事についてアラートを送信

デザイナー上部にある「保存」をクリックしてワークフローを保存します。

次のスケジュール実行を待たずに即時テストするには、[トリガーを実行]ボタンをクリックし[実行]を選択します。ワークフローがリアルタイムで実行されます。

ステップ7: 結果を確認する

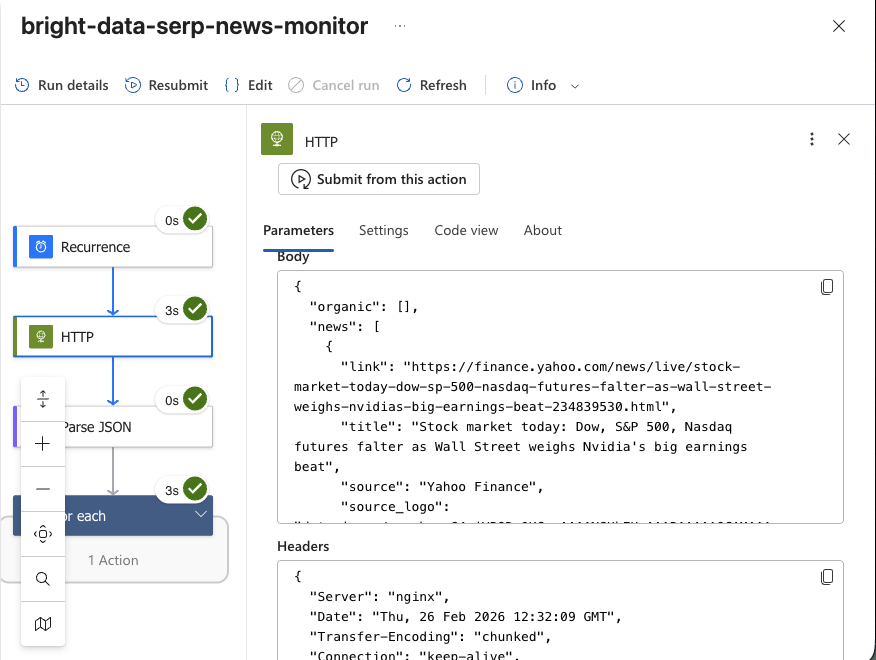

ワークフロー実行後、ロジックアプリの概要ページにある「実行履歴」セクションに移動し、最新の実行をクリックして確認します。

各ステップの視覚的表現が表示され、以下が確認できます:

- –リカーレンストリガー(成功)

- Bright DataのSERP APIからの完全なリクエストとレスポンスを含むHTTPアクション。

- 構造化された出力を含むJSON パースアクション。

- 各反復処理と送信されたメールを含むFor eachループ。

HTTPアクションを展開し、SERPデータが正常に取得されたことを確認してください。レスポンス本文には、指定したトピックに関するGoogleニュースSERPのMarkdownまたはJSONコンテンツが含まれます。

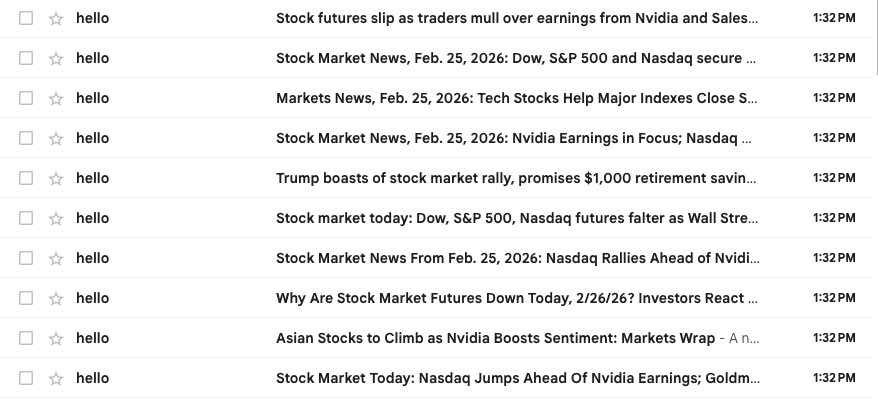

受信トレイを確認してください。「株式市場ニュース」(または設定したトピック)の検索結果に表示された各ニュース記事ごとに個別のメールが届いているはずです。

SERP APIがGoogleから最新のリアルタイム結果を返し、ロジックアプリが自動的に受信トレイへ配信しました。コード不要、サーバー不要、スクレイピングインフラ不要です。 Google検索結果を手動でスクレイピングするのは、ボット対策やレートリミッターのため非常に困難です。Google検索APIを使用すれば、スケーラビリティの制限なく、AI対応のMarkdownまたは構造化JSON形式で、異なる地域のGoogle(またはその他の対応検索エンジン)結果を確実に取得できます。

さらに活用する

この例はシンプルなユースケースを示していますが、ロジックアプリは様々な方向へ拡張可能です:

- SERPデータを同じロジックアプリ内のAzure OpenAIアクションに転送し、Azure AI Foundryチュートリアルで構築したものと同様にニュース記事を要約または評価する。

- Azure SQLまたはCosmos DBコネクタを使用してSERP結果をログに記録し、履歴分析に活用する。

- メール送信ステップをSlackまたはMS Teamsコネクタに置き換え、チームへリアルタイム通知を行う。

- 並列HTTPアクションを追加し、BrightDataのBing検索エンジンエンドポイントや他の検索エンジンを同時にクエリし、結果をマージします。

- Bright DataのWeb Unlockerを統合し、SERP APIが返すURLから記事全文を取得。同一ワークフロー内で詳細な分析を可能にします。

- SERP データを使用して、エージェント型 RAG ワークフローを強化したり、CrewAIやLangChain などのフレームワークに結果をフィードしたりできます。

可能性は事実上無限です!

まとめ

このブログ記事では、Bright DataのSERP APIを使用してGoogleから最新の検索結果を取得し、Azure Logic Appsの自動化されたワークフローに統合する方法を学びました。

ここで紹介したワークフローは、関連コンテンツを自動的に受信トレイに直接配信するノーコードのニュース監視・アラートシステムを構築したい方に最適です。AIファーストのプロンプトエンジニアリングやRAGワークフローに理想的なAzure AI Foundryのアプローチとは異なり、Azure Logic Appsはイベント駆動型自動化、マルチシステム統合、ノーコードのワークフローオーケストレーションが必要な場合に真価を発揮します。

より高度な自動化ワークフローを作成するには、Bright Dataの検索・抽出ツール一式を活用し、ライブWebデータの取得・検証・変換を行ってください。

今すぐBright Dataの無料アカウントに登録し、AI対応のウェブデータソリューションを実際に試してみましょう!