リードジェネレーションは営業の生命線ですが、多くのチームにとって依然として悩ましいボトルネックです。従来の手法は非効率的で偏りが生じやすく、拡張性も乏しいため、優秀な人材を手作業による検索・データ入力・推測作業のサイクルに縛り付けてしまいます。しかし、この重要な機能を煩雑な作業からシームレスな自動化の強みへと変革できたらどうでしょうか?

このガイドでは以下を学びます:

– AIリードジェネレーションの定義

– AIが従来手法を凌駕する理由

– 自社専用のリードジェネレーションエージェントを段階的に構築する方法

– Bright Dataがワークフローを劇的に加速させる方法

さあ始めましょう!

AIリードジェネレーションとは

簡単に言えば、AIリードジェネレーションとは人工知能を活用し、潜在顧客を自動的に発見・収集・強化・選別するプロセスです。生データを即戦力となる営業機会へと変換します。

24時間365日稼働する、極めて効率的なデータ駆動型営業開発担当者と考えてください。単に見込み客を見つけるだけでなく、その本質を理解します。

AIエージェントは、4つの主要アクションに基づくシームレスな自動ワークフローを実行します:

- スクレイピング –Bright Dataのスクレイパーなどのツールを自律的に使用し、ターゲットソース(例:LinkedIn、企業ウェブサイト)から生データを収集します。これが「外部環境との対話」の方法です。

- エンリッチ – エージェントは通常企業詳細であるこの生データを取り込み、他のツールを用いて重要な情報を付加します。メールアドレス、電話番号、技術スタックデータ、企業資金調達ニュース、その他公開データを自動的に見つけ出します。

- スコアリング – AIエージェントの「意思決定」と「問題解決」の中核が発揮される段階です。エンリッチされたデータを用いてリードを評価します。例:

- ルールベースのスコアリング:「業界 = テクノロジー かつ 従業員数 > 50 の場合、10点加算」

- LLMによる推論:LLMがリードのプロフィールと企業ニュースを分析し、理想顧客像(ICP)を説明するニュアンス豊かなプロンプトに基づき適合性を評価します。単純なルールでは表現が難しい複雑な基準も理解可能です。

- エンゲージ:最後にエージェントがアクションを実行します。分析で終わるわけではありません。適格リードをCRMに自動追加したり、パーソナライズされたアウトリーチメールを生成したり、別のプラットフォームで初回接触メッセージを送信したりでき、発見から初回接触までのプロセスを完結させます。

従来のリードジェネレーションが不十分である理由

何十年もの間、リードジェネレーションの営業プロセスはほぼ手作業のままです。営業担当者は手動で見込み客を検索し、限られた情報に基づいて潜在性を判断し、フォローアップが適切なタイミングで忙しい受信箱に届くことを願うだけです。このアプローチは時代遅れであるだけでなく、根本的に欠陥があります。従来の手法が営業チームを失敗に導く理由は以下の通りです:

1.選別における人的バイアス:手動プロセスは直感や主観的判断に大きく依存します。営業担当者は無意識に、馴染みのある企業や特定の役職からのリードを優先してしまう可能性があります。

2.見逃される見込み客:手動でのリード生成は、タブやスプレッドシート、CRM入力の切り替えが混沌としたプロセスです。有望なリードが乱雑なExcelシートで紛失したり、ブラウザタブで忘れられたり、最初の慌ただしさの中でシステムに入力されないことは避けられません。逃したリードは、そのまま収益がファネルから流出することになります。

3.チームの稼働時間の制約:営業チームが働けるのは週40時間(運が良ければ)が限界です。睡眠や休暇、週末が必要です。しかしインターネットは休みません。潜在顧客は24時間ソリューションを調査していますが、手動プロセスでは営業時間中しか対応できません。この

AIによるリードジェネレーションが重要な理由

AIを活用したリードジェネレーションは単なるアップグレードではなく、営業プロセスの完全な変革です。その重要性は、従来手法の根本的な欠陥を直接解決する点にあります:

- 完全自動化:検索やデータ収集といった反復的で時間のかかる作業を処理し、チームが成約に集中できるようにします。

- 24時間365日稼働:人間のチームとは異なり、AIエージェントは昼夜を問わず稼働し、タイムゾーンによる機会の損失を防ぎます。

- データ駆動型意思決定:人間の推測や偏見を排除し、客観的な基準に基づく見込み客選定を実現。最も潜在性の高いリードのみを追求します。

- 即時対応:AIは数分でリードを特定し接触を開始できるため、エンゲージメント率とコンバージョン率が劇的に向上します。

- 無制限の拡張性:数千の見込み客を容易に分析できるため、人員を比例的に増やすことなく営業活動を拡大できます。

AIが営業アプローチを再構築する仕組みを理解した今、自社で構築する方法を把握することが重要です。次に、AI搭載リードジェネレーションエージェントの実践的な構築方法を見ていきましょう。

AIリードジェネレーションエージェントの構築

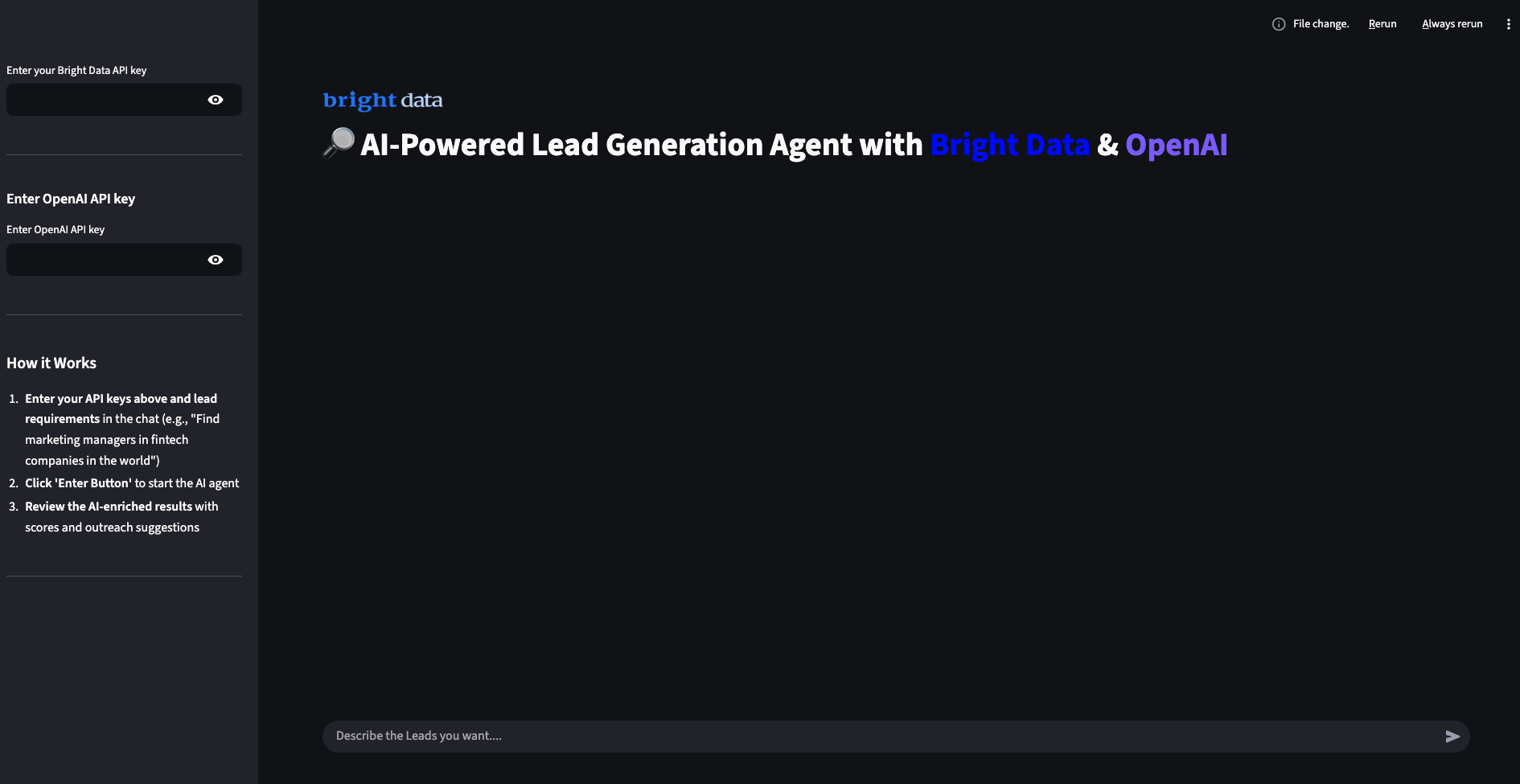

本セクションでは、AIリードジェネレーションエージェントの構築を段階的に解説します。ワークフロー全体を自動化する効率的なエージェントを構築します。Bright DataとStreamlitが連携し、休むことなく稼働するシステムをいかに容易に構築できるかをご確認いただけます。

前提条件

以下の要件を満たした開発環境をセットアップしてください:

- (Python 3.9) 以上

- Bright Dataアカウント:サインアップしAPIトークンを作成(無料トライアルクレジットあり)

- OpenAI APIキー:OpenAIダッシュボードでエンベディングおよびLLMアクセス用のキーを作成

- VS CodeやPyCharmなどのコードエディタ

- Python仮想環境(VE)は依存関係を分離します。

- Streamlitライブラリはインタラクティブなユーザーインターフェースを提供し、ユーザーがツールを利用できるようにします。

環境設定

プロジェクトディレクトリを作成し、依存関係をインストールします。他のPythonプロジェクトとの競合を避けるため、クリーンな仮想環境を設定することから始めます。

python -m venv venv

# macOS/Linux: source venv/bin/activate

# Windows: venvScriptsactivate

pip install langchain langchain-community langchain-openai streamlit python-dotenv lead_generator.pyという新しいファイルを作成し、以下のインポートを追加します。これらのライブラリはウェブスクレイピング、テキスト処理、エンベディング、ユーザーインターフェースを扱います。

import base64

import json

import streamlit as st

import os

import requests

from dotenv import load_dotenv

from typing import Dict, List, Any

from langchain.text_splitter import RecursiveCharacterTextSplitter

from langchain_openai import OpenAIEmbeddings, ChatOpenAI

from langchain_community.vectorstores import FAISS

from langchain.chains import LLMChain

from langchain.prompts import PromptTemplate

from langchain.schema import Document

from langchain.agents import initialize_agent, AgentType, Tool

from langchain.memory import ConversationBufferMemory

from langchain.callbacks import StreamlitCallbackHandler

load_dotenv()Bright Data設定

API認証情報を環境変数で安全に保存します。認証情報を保存する.envファイルを作成し、機密情報をコードから分離します。

BRIGHT_DATA_API_TOKEN="your_bright_data_api_token_here"

OPENAI_API_KEY="your_openai_api_key_here"必要なもの:

- Bright Data API トークン: Bright Data ダッシュボードから生成

- OpenAI APIキー: LLMテキスト生成用

ステップ1: Bright Dataによるデータ収集

LinkedInプロフィールなどからリードデータを取得するための設定を行います。

Bright DataのWebスクレイパーAPIの仕組みに慣れていない場合は、まずドキュメントを確認することをお勧めします。

簡単に説明すると、Web Scraper APIは特定のドメインから公開データを取得できるAPIエンドポイントを提供します。バックエンドでは、Bright Dataがサーバー上で既成のウェブスクレイピングタスクを初期化・実行します。これらのAPIはIPローテーション、CAPTCHAの解決、その他の対策を行い、ウェブページから公開データを効果的かつ倫理的に収集します。タスク完了後、スクレイピングされたデータは構造化された形式にパースされ、スナップショットとして利用可能になります。

したがって、一般的なワークフローは以下の通りです:

- API呼び出しをトリガーしてウェブスクレイピングタスクを開始する。

- スクレイピングされたデータを含むスナップショットの準備状況を定期的に確認する。

- 利用可能になったらスナップショットからデータを取得する。

上記のロジックはわずか数行のコードで実装可能です

class BrightDataCollector:

def __init__(self, api_key: str):

self.api_key = api_key

self.base_url = "https://api.brightdata.com/データセット/v3"

self.headers = {"Authorization": f"Bearer {api_key}"}

def collect_leads(self, filters: Dict[str, Any], limit: int = 10) -> List[Dict[str, Any]]:

# 検索をトリガー

r = requests.post(

f"{self.base_url}/trigger",

headers={**self.headers, "Content-Type": "application/json"},

params={"dataset_id": "gd_your_lead_dataset_id", "type": "discover_new", "limit_per_input": str(limit)},

json=[{

"keyword": f"{filters.get('role','')} {filters.get('industry','')}".strip(),

"location": filters.get("location", "")

}]

)

snapshot_id = r.json().get("snapshot_id")

if not snapshot_id:

return []

# 準備完了までポーリング

url = f"{self.base_url}/snapshot/{snapshot_id}?format=json"

for _ in range(30):

snap = requests.get(url, headers=self.headers)

if snap.status_code == 200:

return snap.json()

time.sleep(5)

return []ステップ2: AIによるリードの選別

生のリードを収集したら、次の課題は理想的な顧客プロファイルに合致するリードを特定することです。手動でのスコアリングではなく、検索パラメータを抽出し、リードを分析し、関連性スコアを割り当て、最適な一致を強調表示するAIスクリーナーを利用できます。

以下のクラスでは、LangChainとOpenAiを用いたこのワークフローの構築方法を示します。

"""AIによるリード選別とスコアリング"""

def __init__(self, api_key: str):

self.llm = ChatOpenAI(api_key=api_key, model_name="gpt-3.5-turbo", temperature=0.3)

self.embeddings = OpenAIEmbeddings(api_key=api_key)

# 選別用プロンプト

self.analysis_prompt = PromptTemplate(

input_variables=["query", "lead"],

template="""

元のクエリ: {query}

リード: {lead}

以下のJSONを返す:

- スコア (1-100)

- 分析結果

- 課題点

- 価値提案

- 意思決定者レベル

- エンゲージメント確率

"""

)

self.analysis_chain = LLMChain(llm=self.llm, prompt=self.analysis_prompt)

def qualify(self, lead: dict, query: str) -> dict:

"""単一リードを評価"""

result = self.analysis_chain.run(query=query, lead=json.dumps(lead))

return {**lead, **json.loads(result)}

def batch_qualify(self, leads: list, query: str) -> list:

"""リードの適格判定とランク付け"""

results = [self.qualify(lead, query) for lead in leads]

return sorted(results, key=lambda x: x["score"], reverse=True)

def vector_store(self, leads: list):

"""意味検索用FAISSベクトルストアを構築"""

docs = [Document(page_content=f"{l['name']} {l['title']} {l['company']}", metadata={"i": i})

for i, l in enumerate(leads)]

return FAISS.from_documents(docs, self.embeddings)ステップ3: インタラクションのためのStreamlit UI

APIキーの設定、AI設定の制御、視覚的に明確なリード探索を可能にし、すべてを統合するUIレイヤーです

st.set_page_config(page_title="AIリードジェネレーションエージェント", page_icon="🎯", layout="wide")

# ヘッダー

st.title("🔎 AI搭載リードジェネレーションエージェント")

# サイドバー設定

with st.sidebar:

st.header("APIキー")

bright_data_api_key = st.text_input("Bright Data APIキー", type="password")

openai_api_key = st.text_input("OpenAI APIキー", type="password")

st.header("設定")

model_name = st.selectbox("OpenAI Model", ["gpt-3.5-turbo", "gpt-4"])

max_leads = st.slider("Max Leads", 5, 50, 10)

# チャットインターフェース

if "messages" not in st.session_state:

st.session_state.messages = []

for msg in st.session_state.messages:

with st.chat_message(msg["role"]):

st.markdown(msg["content"])

user_input = st.chat_input("理想的なリードについて説明してください...")

if user_input:

st.session_state.messages.append({"role": "user", "content": user_input})

st.chat_message("user").markdown(user_input)

# プレースホルダー: AIがフィルターを抽出しリードを取得中

st.chat_message("assistant").markdown("フィルター抽出中、リードを取得中...")

# 簡易リードカード表示

def display_lead_card(lead: Dict[str, Any]):

with st.expander(f"{lead.get('name')} - {lead.get('title')} at {lead.get('company')}"):

st.write(f"所在地: {lead.get('location', 'N/A')}")

st.write(f"Email: {lead.get('email', 'N/A')}")

st.write(f"LinkedIn: {lead.get('linkedin', 'N/A')}")

st.write(f"Score: {lead.get('score', 0)}/100")

# リードの例

sample_leads = [

{"name": "Jane Doe", "title": "Marketing Manager", "company": "Fintech Co", "location": "CA", "email": "[email protected]", "linkedin": "linkedin.com/janedoe", "score": 85}

]

st.subheader("見込み顧客")

for lead in sample_leads:

display_lead_card(lead)このUIにより、ユーザーは生のJSONスコアだけでなく、ランク付けされたリード、インサイト、エンゲージメントの可能性を一目で確認できます。

ステップ4: フォローアップの自動化

見込み客を選別した後も、適切なタイミングで適切なメッセージで接触する必要があります。そこで自動化が役立ちます。FollowUpAutomatorクラスはパーソナライズされたアウトリーチメール、LinkedInメッセージ、フォローアップを生成し、構造化されたシーケンスでスケジュールと実行を行います。

class FollowUpAutomator:

"""見込み顧客向け基本自動フォローアップシステム"""

def __init__(self, api_key: str):

self.llm = ChatOpenAI(api_key=api_key, model_name="gpt-3.5-turbo", temperature=0.7)

# 簡易テンプレート

self.initial_prompt = PromptTemplate(

input_variables=["name", "company"],

template="{company}の{name}宛に、簡潔で親しみやすいアウトリーチメールを作成してください。"

)

self.followup_prompt = PromptTemplate(

input_variables=["name", "company"],

template="{company}の{name}宛に、80語以内で丁寧なフォローアップメールを作成してください。"

)

self.linkedin_prompt = PromptTemplate(

input_variables=["name", "industry"],

template="{industry}業界の{name}宛に、短いLinkedInのコネクションメッセージを作成してください。"

)

self.initial_chain = LLMChain(llm=self.llm, prompt=self.initial_prompt)

self.followup_chain = LLMChain(llm=self.llm, prompt=self.followup_prompt)

self.linkedin_chain = LLMChain(llm=self.llm, prompt=self.linkedin_prompt)

def create_sequence(self, lead: Dict[str, Any]) -> List[Dict[str, Any]]:

"""1件のリードに対する3段階のアウリーチシーケンスを構築"""

return [

{"day": 0, "type": "email", "content": self.initial_chain.run(name=lead["name"], company=lead["company"])},

{"day": 2, "type": "linkedin", "content": self.linkedin_chain.run(name=lead["name"], industry=lead.get("industry", ""))},

{"day": 7, "type": "email", "content": self.followup_chain.run(name=lead["name"], company=lead["company"])}

]

def schedule(self, leads: List[Dict[str, Any]]) -> List[Dict[str, Any]]:

"""各コンタクトに日付を割り当てる"""

scheduled = []

for lead in leads:

base = datetime.now()

sequence = self.create_sequence(lead)

for touch in sequence:

touch["scheduled_date"] = base + timedelta(days=touch["day"])

touch["lead"] = lead["name"]

scheduled.append({"lead": lead["name"], "sequence": sequence})

return scheduledステップ5: コードの完成と実行

lead_generator.py内の最終コードを以下のように実行できます:

streamlit run lead_generator.pyコードベース全体を実行すると、アシスタントがクエリを受け取り、Bright Dataから最新のリードを取得し、AI駆動のスコアリングとインサイトによってそれらを強化します。10件のリードごとにバッチ処理が行われ、最大40件の求人情報が分析され、関連性、意思決定力、エンゲージメント確率に基づいてスコアリングとランク付けが行われます。 最後に、強化された結果の完全なセットが整理されたresults.csvファイルにエクスポートされます。単なる連絡先リストではなく、即座に活用可能なAI審査済みリードデータベースが提供されます。

まとめ

これで、見込み客開拓ワークフロー全体を自動化するAI搭載リードジェネレーションエージェント構築の完全なフレームワークが完成しました。このシステムはウェブから新規データを自律的に収集し、重要なコンテキストで強化し、理想的な顧客プロファイルに基づいてリードをインテリジェントに選別し、即時エンゲージメントの準備を整えます。

このアプローチの真の力は柔軟性にあります。Bright DataとLLMの設定でターゲットデータソースと評価基準を変更するだけで、SaaSや金融からEC、採用まであらゆる業界にこのフレームワークを適応できます。モジュール設計により、営業プロセスの進化に合わせて新たなデータエンドポイント、スコアリングアルゴリズム、出力チャネルを容易に組み込めます。

より高度で強力なワークフローを構築するには、Bright Dataのドキュメントで提供される全データセットとソリューションの活用を推奨します。

今すぐ無料のBright Dataアカウントを作成し、トライアルクレジットを活用して独自の自動リード生成エージェント構築を開始しましょう。売上パイプラインを「水漏れする蛇口」から予測可能な高速収益エンジンへと変革します。